LinkedIn et le C2PA unissent leurs forces pour identifier les contenus créés par IA

Avec la prolifération des contenus créés par l’intelligence artificielle, la transparence et l’authenticité sont devenus des enjeux cruciaux.

LinkedIn a récemment annoncé son intention d’adopter des étiquettes spécifiques pour les contenus IA, et ce, en partenariat avec le C2PA. Cette démarche vise à indiquer la provenance des images et des vidéos, renforçant ainsi la confiance des utilisateurs et limitant la diffusion de contenus trompeurs.

L’importance de la détection et de l’étiquetage des contenus générés par l’IA

Les outils d’intelligence artificielle sont devenus omniprésents sur les réseaux sociaux, permettant de créer des contenus visuels souvent indiscernables des créations humaines. Cette efficacité les rend populaires auprès des spécialistes du marketing, des créateurs de contenus, et même des amateurs. Cependant, cette prolifération pose des problèmes en termes d’authenticité et de véracité, rendant difficile la distinction entre le vrai et le faux.

L’un des plus grands risques associés à l’utilisation de l’IA sur les réseaux sociaux est la création et l’exploitation de contenus à des fins malveillantes. Les DeepFakes, par exemple, sont des vidéos falsifiées mettant en scène artificiellement des personnages dans le but de désinformer.

Ce type de manipulation peut avoir de lourdes conséquences, notamment en périodes sensibles. Des vidéos falsifiées d’interventions militaires ou des représentations erronées de personnalités politiques peuvent par exemple semer la confusion et altérer l’opinion publique. Même après démenti, le mal peut déjà être fait.

Il est donc essentiel de disposer de systèmes efficaces de détection et d’étiquetage des contenus IA pour limiter ces risques.

LinkedIn en partenariat avec le C2PA pour traquer et identifier les contenus créés ou modifiés avec l’IA

D’abord, c’est quoi le C2PA ?

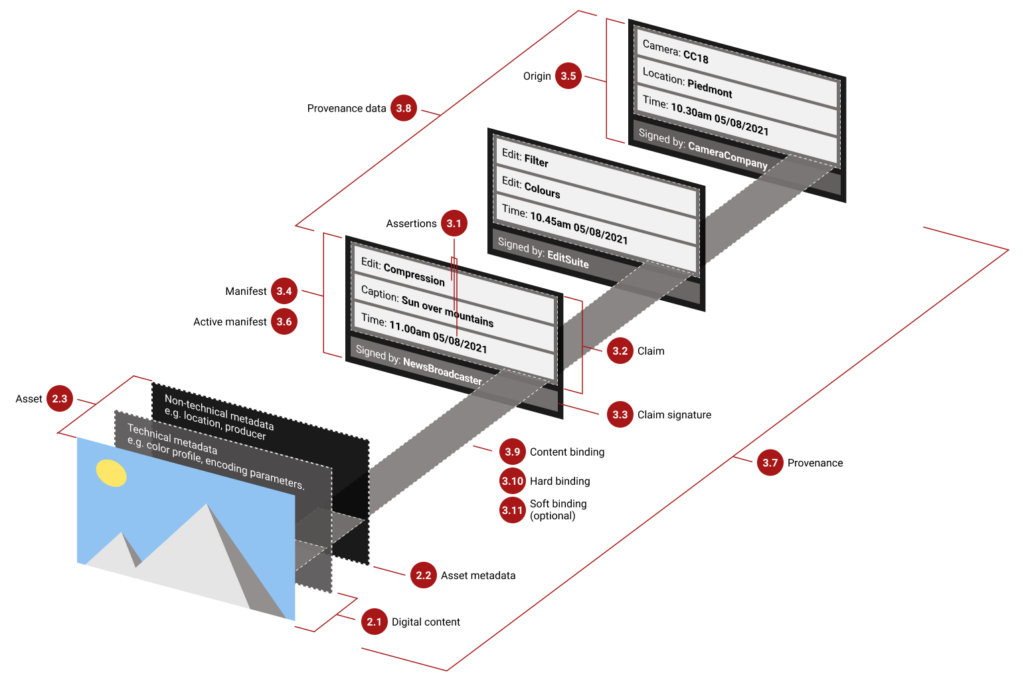

Le C2PA1, Coalition for Content Provenance and Authenticity, est un organisme chargé d’établir des normes techniques garantissant la provenance et l’authenticité des contenus numériques. Initiée par de grands groupes technologiques tels que Microsoft, Adobe, Intel, et la BBC, cette coalition a grandi en accueillant des membres influents comme Google, Meta, et OpenAI. Le principal objectif du C2PA est de proposer des solutions techniques performantes permettant de tracer l’origine des images et des vidéos, renforçant ainsi leur crédibilité.

Comme le déclare LinkedIn2, qui se réjouit de ce partenariat :

En fournissant une trace de l’origine du contenu et des modifications apportées, la C2PA aide à maintenir la fiabilité des informations numériques, à protéger contre les utilisations non autorisées, ainsi qu’à créer un environnement transparent et sécurisé pour les créateurs, éditeurs et utilisateurs.

Comment fonctionnent les étiquettes de marquage des contenus d’IA ?

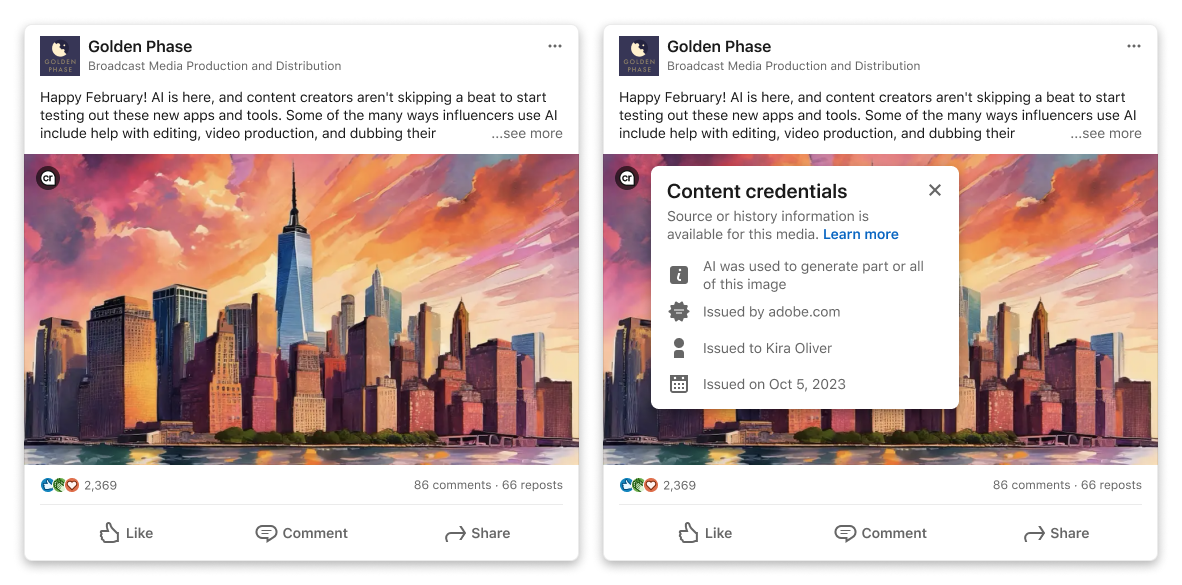

Pour marquer le contenu généré par IA, le C2PA intègre une sorte d’estampille numérique aux images et aux vidéos. Ce procédé de marquage, généralement appelé “Content Credentials”, inclut des informations propres au contenu, telles que sa date de création, l’auteur, ainsi que les outils utilisés pour son édition.

Sur LinkedIn, chaque image ou vidéo produite par IA sera désormais automatiquement marquée par une icône “CR” dans le coin supérieur gauche du visuel.

Grâce à ce processus, l’utilisateur pourra distinguer un contenu authentique d’un contenu généré par IA, réduisant ainsi de manière significative le risque de diffusion d’informations erronées.

Patrick Corrigan, vice-président de LinkedIn, explique :

Vous pourrez retracer l’origine des médias créés par IA, y compris la source et l’historique du contenu, et déterminer s’ils ont été créés ou modifiés par IA.

Il faut savoir par ailleurs que le marqueur “CR” pour le contenu IA n’est pas facile à supprimer, garantissant une transparence continue et fiable.

Questions fréquentes sur le sujet

Qu’est-ce que l’étiquetage du contenu généré par l’IA sur LinkedIn ?

L’étiquetage du contenu généré par l’IA sur LinkedIn est une initiative visant à fournir aux utilisateurs des informations sur l’origine et l’authenticité des images et des vidéos présentes sur la plateforme, créées ou modifiées à l’aide de l’intelligence artificielle.

Quel est l’objectif de l’étiquetage du contenu généré par l’IA sur LinkedIn ?

L’étiquetage du contenu généré par l’IA a pour objectif principal d’assurer la transparence et l’authenticité du contenu généré par IA sur LinkedIn. Cela permet de renforcer la confiance des utilisateurs vis-à-vis des images et vidéos qu’ils découvrent sur la plateforme.

Pourquoi est-il important de marquer le contenu généré par IA ?

Le marquage des contenus générés par l’intelligence artificielle est important pour réduire le risque de propagation de fausses informations et de deepfakes qui peuvent impacter négativement l’opinion publique.

Comment reconnaître un contenu généré par IA sur LinkedIn grâce à l’étiquetage C2PA ?

LinkedIn utilise un système de marque numérique qui fait apparaître la mention “CR” pour “Content Credentials” dans le coin supérieur gauche de l’image ou de la vidéo. Il s’agit d’une icône qui permet à l’utilisateur de disposer de toutes les informations nécessaires pour tracer l’origine du visuel et les manipulations qu’il a subies.

Une initiative déjà adoptée par d’autres plateformes de réseaux sociaux

D’autres réseaux sociaux ont déjà pris les mêmes dispositions que LinkedIn pour identifier et étiqueter le contenu généré par IA. Parmi ces plateformes, on compte des géants comme TikTok, YouTube et Meta (anciennement Facebook).

TikTok3 a récemment annoncé son adhésion aux normes C2PA pour retracer le contenu généré par IA, démontrant ainsi son engagement en faveur de la transparence numérique.

YouTube, de son côté, a mis en place plusieurs mesures pour réglementer l’utilisation de l’IA générative, notamment en ajoutant des mentions spécifiques pour identifier le contenu manipulé.

Meta a pris des précautions similaires en déployant le filigrane « Imagine with Meta » sur les images créées par son IA génératrice d’images.

Références

- Coalition for Content Provenance and Authenticity. Plateforme C2PA, consultée le 21 mai 2024. ↩︎

- Threads. Consulté le 21 mai 2024. ↩︎

- Partnering with our industry to advance AI transparency and literacy. TikTok, du 9 mai 2024. Consulté le 21 mai 2024. ↩︎