YouTube déclare la guerre aux deepfakes… avec une cuillère en bois

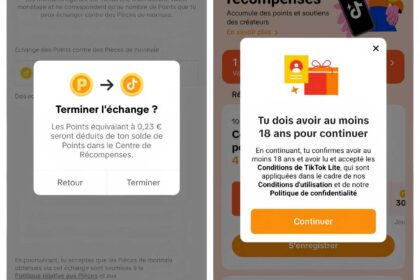

Désormais, si ton image ou ta voix se retrouve dans une vidéo YouTube sans ton consentement, tu peux demander sa suppression pour violation de vie privée.

Cette nouvelle mesure a été discrètement introduite dans la politique de confidentialité1 de la plateforme depuis juin 2024 comme un une petite ligne dans les conditions d’utilisation d’un contrat d’assurance que personne ne lit.

Alors, faut-il sortir les confettis ou lever un sourcil sceptique ?

Si l’intention est louable, l’application de cette nouvelle règle ressemble plutôt à un filet de sécurité avec des trous béants.

Et on a des tas de raisons de penser ainsi.

Une politique à la carte

YouTube te promet qu’en cas de vidéo deepfake te concernant, tu peux demander à la supprimer. Mais voilà, ce n’est pas parce que tu cries « Au secours » que la vidéo va disparaître illico.

La plateforme examine2 d’abord ta plainte en fonction d’un certain nombre de critères.

Et selon les résultats de leur « évaluation » », ta demande peut aboutir ou finir aux oubliettes.

Autant dire que là YouTube est à la fois juge, jury et exécuteur des sentences.

Mais est-ce vraiment impartial ? Surtout quand ses revenus dépendent de l’engagement et des vues générées par ces vidéos controversées.

YouTube compte sur les utilisateurs pour le ménage des deepfakes

Il faut que tu signales d’abord le contenu qui utilise ton image ou ta voix, avant qu’ils ne réagissent.

Logique non.

C’est un peu comme porter plainte avant que la police ne t’aide. Ça va dans le bon sens, mais c’est loin d’être suffisant.

Oui, ça peut aider les victimes après coup, mais ça ne règle pas le fond du problème.

YouTube pourrait faire mieux, non ?

S’ils veulent vraiment aider leurs utilisateurs, ils pourraient mettre en place des systèmes plus proactifs.

Pourquoi ne pas déployer des algorithmes capables de détecter automatiquement et de bloquer les deepfakes avant qu’ils ne deviennent viraux ?

Après tout, ils nous vendent de l’IA capable de créer des vidéos, alors pourquoi pas une IA qui, pour une fois, nous protège des abus ?

Oui, je sais, on en demande beaucoup.

Mais à ce stade, c’est nécessaire. De toute façon, ils ont les moyens techniques et financiers pour…

Une politique de tolérance à géométrie variable

Autre point qui mérite qu’on s’y attarde : aucune sanction pour les créateurs à la première infraction. Oui, oui, vous avez bien lu.

Si un youtubeur utilise ton image ou ta voix sans autorisation pour promouvoir par exemple un produit douteux, il pourra repartir tranquillement sans même un avertissement.

À la place, la plateforme se réserve le droit de retirer tout simplement la vidéo si elle est jugée problématique. Et puis, c’est tout.

Même si YouTube affirme qu’il pourrait serrer la vis en cas de récidive, il ne mentionne pas à partir de combien on tombe dans le récidive ?

C’est un peu comme si, en classe, on laissait tricher sans conséquence la première fois. Forcément, certains vont tester les limites.

YouTube laisse donc la porte ouverte … Après tout, il ne faut pas trop fâcher les créateurs, ces précieux fournisseurs de contenu qui font tourner la machine à cash.

YouTube, défenseur de la vie privée ou champion du double jeu ?

Bon, soyons honnêtes : c’est bien que YouTube prenne enfin le problème des deepfakes au sérieux.

Parce qu’on ne va pas se mentir, c’est flippant de savoir que quelqu’un peut utiliser l’IA pour te faire dire ou faire des trucs que tu n’as jamais dits ou faits, en quelques clics.

Mais le hic, c’est que YouTube essaie de se donner des airs de bon samaritain mais en réalité, la plateforme semble davantage préoccupée par le fait de ne pas se mettre à dos ses créateurs de contenu que par une véritable protection des utilisateurs.

Les utilisateurs doivent donc rester vigilants et ne pas trop compter sur la plateforme pour jouer les chevaliers blancs.

Quelques conseils pour les entrepreneurs

En tant qu’entrepreneur, freelance ou petite entreprise, que faire si ton image ou celle de ta marque se retrouve utilisée à des fins discutables ?

Signaler3 sur YouTube est une première étape, mais il ne faut pas s’arrêter là.

En cas d’usurpation avérée, il ne faut pas hésiter à explorer les recours juridiques.

Et si tu publies du contenu sur YouTube :

- Évite de jouer aux apprentis sorciers juste pour le buzz : pas de deepfake

- Reste transparent : Indique clairement l’utilisation de l’IA

- Obtient toujours une autorisation avant d’utiliser l’image, la voix et d’ autres informations.

Et toi comment tu trouve la nouvelle règle concernant le retrait des deepfakes IA sur YouTube ? Partage ton avis avec nous. On sera ravis de te lire.

Références

- Règles de confidentialité Youtube. Support Google. Consulté le 5 juillet 2024. ↩︎

- YouTube now lets you request removal of AI-generated content that simulates your face or voice. TechCrunch, du 1 juillet 2024. Consulté le 5 juillet 2024. ↩︎

- Vous pouvez demander à YouTube d’effacer les DeepFakes de vous : voici comment. Lebigdata, du 3 juillet 2024.Consulté le 5 juillet 2024. ↩︎